全面解析AI课程学总结:涵要点、技巧与实践心得报告

# 全面解析课程学涵要点、技巧与实践心得报告

## 引言

随着人工智能技术的飞速发展,越来越多的人开始关注并学相关知识。本文将全面解析课程学总结涵课程要点、学技巧以及实践心得,帮助读者更好地掌握知识体系提升个人技能。

## 一、课程要点总结

### 1. 课程概述

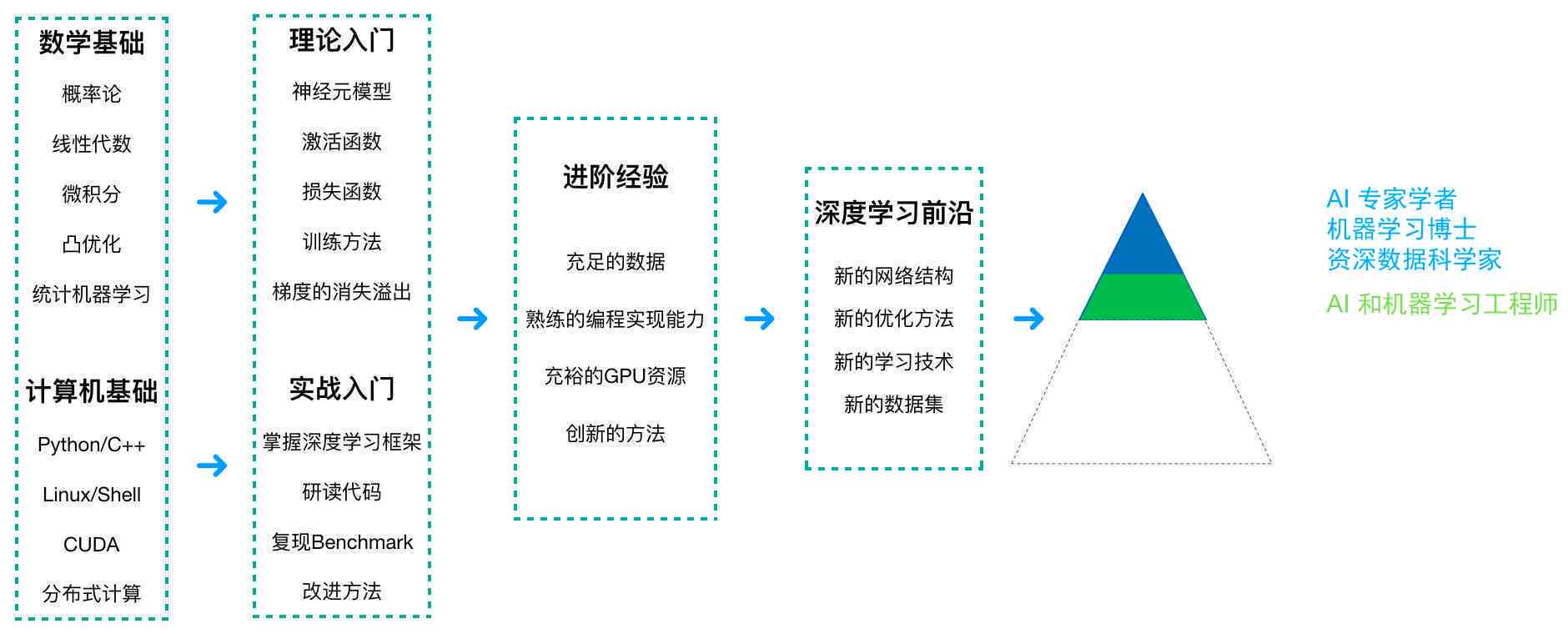

课程主要涉及机器学、深度学、自然语言应对、计算机视觉等领域的知识。在学进展中,咱们需要理解以下要点:

- 基础理论:掌握概率论、线性代数、微积分等基础数学知识为后续学打下基础。

- 编程语言:熟悉Python编程,掌握常用的框架,如TensorFlow、PyTorch等。

- 数据预解决:理解数据清洗、数据标准化、数据增强等方法,为模型训练提供高优劣数据。

- 机器学算法:学线性回归、逻辑回归、支持向量机、决策树、随机森林等算法。

- 深度学算法:学神经网络、卷积神经网络(CNN)、循环神经网络(RNN)、长短时记忆网络(LSTM)等算法。

- 自然语言解决:掌握词向量、序列标注、文本分类等NLP任务。

- 计算机视觉:学图像分类、目标检测、图像分割等任务。

### 2. 课程要点详解

以下是对课程要点的详细解释:

#### (1)基础理论

- 概率论:理解概率分布、条件概率、叶斯定理等基本概念。

- 线性代数:掌握矩阵运算、向量空间、特征值和特征向量等知识。

- 微积分:熟悉导数、积分、微分方程等基本概念。

#### (2)编程语言

- Python:学Python基本语法、数据结构、函数、模块等。

- 框架:掌握TensorFlow、PyTorch等框架的基本采用方法。

#### (3)数据预解决

- 数据清洗:去除数据中的异常值、缺失值等。

- 数据标准化:将数据缩放到同一量级,提升模型训练效果。

- 数据增强:对数据实变换,增进模型的泛化能力。

#### (4)机器学算法

- 线性回归:按照输入和输出之间的线性关系实行建模。

- 逻辑回归:应对二分类疑惑,通过Sigmoid函数将线性回归的结果映射到[0,1]区间。

- 支持向量机:寻找一个更优的超平面,将不同类别的数据分开。

- 决策树:通过树状结构对数据实划分实现分类或回归任务。

- 随机森林:基于决策树的集成学算法,通过构建多棵决策树实行投票加强模型的泛化能力。

#### (5)深度学算法

- 神经网络:由多个神经元组成的层次化结构,用于特征提取和分类。

- 卷积神经网络(CNN):用于图像识别、目标检测等任务,具有局部感知、参数共享等特点。

- 循环神经网络(RNN):用于解决序列数据,如语音识别、机器翻译等任务。

- 长短时记忆网络(LSTM):改进RNN的梯度消失疑惑,适用于长序列数据。

#### (6)自然语言解决

- 词向量:将文本中的词语映射到高维空间,实现词语的向量表示。

- 序列标注:对文本中的每个词语实分类,如命名实体识别、词性标注等。

- 文本分类:依据文本内容实行分类如情感分析、新闻分类等。

#### (7)计算机视觉

- 图像分类:对图像实分类如识别图片中的物体、场景等。

- 目标检测:识别图像中的多个物体,并标注其位置和类别。

- 图像分割:将图像中的每个像素实行分类,如语义分割、实例分割等。

## 二、学技巧与实践心得

### 1. 学技巧

- 明确学目标:在学期间,明确自身的学目标,有针对性地实行学。

- 理论联系实际:通过实践项目,将理论知识应用到实际难题中,升级本身的实践能力。

- 积极参与讨论:与同学、老师实行交流,分享学心得,宽视野。

- 定期复:及时复所学知识固记忆,避免遗忘。

### 2. 实践心得

- 动手实践:通过实际操作,掌握算法的应用,加强本身的编程能力。

- 项目驱动:以项目为主线,串联所学知识,形成完整的知识体系。

- 持续学:人工智能领域发展迅速要时刻关注行业动态,不断学新知识。

- 培养团队协作能力:在项目实践中,与团队成员密切配合共同完成任务。

## 三、总结

本文从课程要点、学技巧与实践心得三个方面实全面解析,旨在帮助读者更好地学知识提升个人技能。通过本文的介绍,相信读者对课程有了更深入的熟悉,为今后的学和发展奠定了基础。在未来的学进展中,期待读者可以积极实践,不断积累经验,成为人工智能领域的优秀人才。

全面解析AI课程学总结:涵要点、技巧与实践心得报告

编辑:ai知识-合作伙伴

本文链接:http://www.tsxnews.com.cn/2024falv/aizhishi/417213.html

① 凡本网注明"来源:"的所有作品,版权均属于,未经本网授权不得转载、摘编或利用其它方式使用上述作品。已经本网授权使用作品的,应在授权范围内使用,并注明"来源:XX"。违反上述声明者,本网将追究其相关法律责任。

② 凡本网注明"来源:xxx(非)"的作品,均转载自其它媒体,转载目的在于传递更多信息,并不代表本网赞同其观点和对其真实性负责。

③ 如因作品内容、版权和其它问题需要同本网联系的,请在30日内进行。

编辑推荐

- 1AI写作助手:全方位解决写作难题与提升文章质量的关键技巧

- 1越AI写作助手:全面提升创作效率的智能写作平台

- 1更优秀的AI写作平台:盘点智能写作机平台与顶级工具

- 1顶级AI写作助手:全方位解析2023智能写作工具及功能比较

- 1甜蜜情话:爱情谐音创意文案集锦

- 1ai谐音的字:寓意美好、爱情谐音精选及成语、词语汇编

- 1探索谐音成语乐趣:全面收录热门爱谐音成语及创意用法解析

- 1人工智能助力的谐音成语大揭秘

- 1ai文案成语谐音大全:爱谐音成语及解释

- 1AI文案创作中的成语谐音攻略:全面解析相关搜索问题与实用技巧

- 1免费AI智能写作助手:在线创作工具助力高效写作

- 1深入了解电脑AI人工智能写作:全方位指南助您掌握高效智能写作技巧

- 1电脑AI人工智能写作怎么弄出来的:揭秘技术原理与实践应用

- 1'智能AI辅助写作软件:高效创作助手,助力内容生成'

- 1全方位解析:电脑人工智能技术在多领域的应用与未来发展

- 1人工智能AL写作:涵写作、写稿、AI作诗,开启人工智能写作之一案

- 1'智能创作助手:AI驱动的写作机器人革新体验'

- 1探索CG艺术之美:全面揭秘画境CG创作技巧与灵感源泉

- 1画境系列:电视价格解析、游戏、CG、官网及第五集汇总

- 1沉浸式艺术之旅:画境官方网站探索