深入解析:AI脚本编写全过程与关键技巧——从入门到高级实践

深入解析:脚本编写全过程与关键技巧——从入门到高级实践

随着人工智能技术的不断发展脚本编写已成为多开发者和研究者的必备技能。本文将从入门到高级实践深入解析脚本编写的全过程与关键技巧帮助读者更好地理解和掌握这一技术。

一、入门篇:脚本编写的基石

1. 理解脚本的概念

脚本是一种用于指导人工智能系统实特定任务的程序代码。它多数情况下包含数据预应对、模型训练、模型评估和推理等环节。编写脚本需要掌握一定的编程语言基础,如Python、C 等。

2. 选择合适的编程语言

Python是编写脚本的常用语言,因为它具有丰富的库和框架,如TensorFlow、PyTorch等,可方便地实现各种复杂的算法。Python语法简洁易于学,非常适合初学者。

3. 掌握基本的数据结构和算法

理解基本的数据结构(如列表、字典、元组等)和算法(如排序、查找等)是编写脚本的基础。这些知识有助于更好地组织和解决数据,增进脚本的行效率。

4. 学脚本的基本框架

一个典型的脚本包含以下四个部分:

(1)导入所需库和模块

(2)定义数据预应对函数

(3)定义模型训练函数

(4)定义模型评估和推理函数

二、进阶篇:脚本编写的关键技巧

1. 数据预应对

数据预解决是脚本编写的关键环节其目的是将原始数据转换为适合模型训练和推理的格式。以下是若干常见的数据预应对技巧:

(1)数据清洗:去除数据中的噪声、异常值和重复数据。

(2)数据标准化:将数据转换为具有相同尺度的数值,以便模型更好地学。

(3)数据归一化:将数据缩放到[0, 1]或[-1, 1]范围内,减低模型训练的难度。

(4)数据增强:通过旋转、缩放、裁剪等方法扩充数据集增进模型的泛化能力。

2. 模型选择与调优

(1)选择合适的模型:依据任务需求选择合适的模型,如卷积神经网络(CNN)用于图像识别,循环神经网络(RNN)用于自然语言解决等。

(2)模型参数调优:通过调整学率、批量大小等参数,优化模型的性能。

(3)正则化:添加正则化项(如L1、L2)以防止模型过拟合。

3. 模型训练与评估

(1)训练模型:利用训练数据集训练模型,监控训练进展中的损失函数和准确率等指标。

(2)评估模型:利用验证数据集评估模型的性能,调整模型参数以优化性能。

(3)模型保存与加载:保存训练好的模型,以便后续利用。

4. 推理与部署

(1)模型推理:利用训练好的模型对测试数据集实行预测。

(2)部署模型:将模型部署到服务器或移动设备,以实现实际应用。

三、高级实践:脚本编写的高级技巧

1. 分布式训练

分布式训练可将大型数据集分割到多个节点上,提升训练效率。常用的分布式训练框架有Horovod、Parameter Server等。

2. 模型压缩与量化

模型压缩与量化可以减小模型大小,减低存和计算成本。常用的方法有权重剪枝、权重量化等。

3. 迁移学

迁移学可以复用预训练模型的参数,加快训练速度,加强模型性能。常用的预训练模型有VGG、ResNet等。

4. 模型优化与加速

通过优化算法和硬件加速,能够提升模型的实效率。常用的优化方法有梯度下降、动量等;硬件加速包含GPU、TPU等。

本文从入门到高级实践详细介绍了脚本编写的全过程与关键技巧。掌握这些技巧,能够帮助读者更好地理解和应用人工智能技术,为我国人工智能产业的发展贡献力量。在实际编写进展中,还需不断积累经验,不断优化脚本,以加强模型的性能和实用性。

深入解析:AI脚本编写全过程与关键技巧——从入门到高级实践

编辑:ai知识-合作伙伴

本文链接:http://www.tsxnews.com.cn/2024falv/aizhishi/264486.html

① 凡本网注明"来源:"的所有作品,版权均属于,未经本网授权不得转载、摘编或利用其它方式使用上述作品。已经本网授权使用作品的,应在授权范围内使用,并注明"来源:XX"。违反上述声明者,本网将追究其相关法律责任。

② 凡本网注明"来源:xxx(非)"的作品,均转载自其它媒体,转载目的在于传递更多信息,并不代表本网赞同其观点和对其真实性负责。

③ 如因作品内容、版权和其它问题需要同本网联系的,请在30日内进行。

编辑推荐

- 1ai智能写稿脚本怎么用

- 1'掌握AI智能写稿脚本:轻松高效创作内容教程'

- 1ai作业是什么意思及类型,ai作业员职责与智能作业介绍

- 1AI辅助作业被发现后的处理措与影响:后果、应对策略及合规建议

- 1AI创作与人类艺术家:未来艺术界将如何融合与创新?

- 1智能少女AI执导:跨界创作科幻影片宴

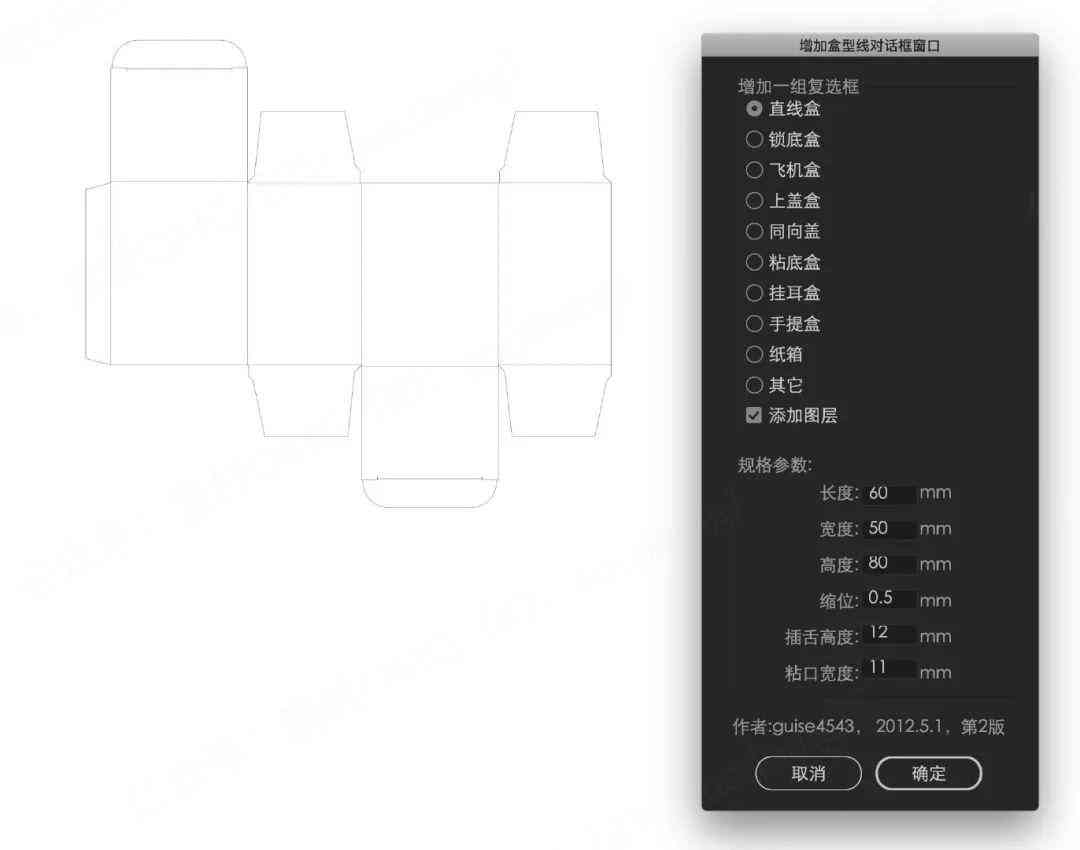

- 1AI辅助设计:如何利用智能工具创建高效剪切模版

- 1AI文案创作工具:全方位打造原创文章,解决各类写作难题

- 1ai智能写作网站免费:官网推荐、热门平台及英语版本一览

- 1探索抖音热门民族拍照特效:一键换装56个民族服饰,解锁旅拍新潮流

- 1全面解读:AI技术如何深度赋能产品运营与创新策略提升

- 1探秘AI虚拟人物:数字世界的智能生命体之谜

- 1探索小皮:性能与性价比深度解析

- 1揭秘绊爱CV:全方位了解虚拟YouTuber绊爱背后的声优及其作品

- 1AI分身照片文案:打造独特个性形象,引领社交新潮流

- 1探索AI智能创作:如何在旅游攻略中启用个性化生成功能

- 1探索AI旅游攻略创作工具:一站式搜索与生成攻略的全方位指南

- 1癌病理报告(-)癌症与癌变病理学意义解析

- 1智能AI助力:深度解读病理报告,提升诊断精准度

- 1全面解读病理报告:AR技术助力精准医疗与疾病诊断

- 1AI病理诊断技术在临床报告中的应用及优势解析

- 1病理学诊断报告:详细vg分析与解读