AI辅助编写全方位爬虫脚本教程:从入门到高级实践指南

在数字化时代数据的必不可少性不言而。而爬虫技术作为一种高效获取网络数据的方法已经成为数据分析师、开发者和研究人员的必备技能。编写全方位爬虫脚本往往需要具备一定的编程基础和丰富的实践经验。本文将向您介绍怎么样利用辅助编写全方位爬虫脚本从入门到高级实践,助您轻松掌握这一技能。

## 辅助编写全方位爬虫脚本教程:从入门到高级实践指南

### 引言

随着互联网的快速发展,大量的信息资源以数字化形式存在。怎样高效地获取这些数据,成为多企业和个人关注的点。传统的爬虫技术虽然可以满足基本需求,但编写和维护一个全方位的爬虫脚本却并非易事。本文将为您详细讲解怎样利用辅助编写全方位爬虫脚本,从入门到高级实践,让您轻松应对各种网络数据抓取需求。

## 怎样利用辅助编写爬虫脚本

### 安装辅助编写爬虫脚本工具

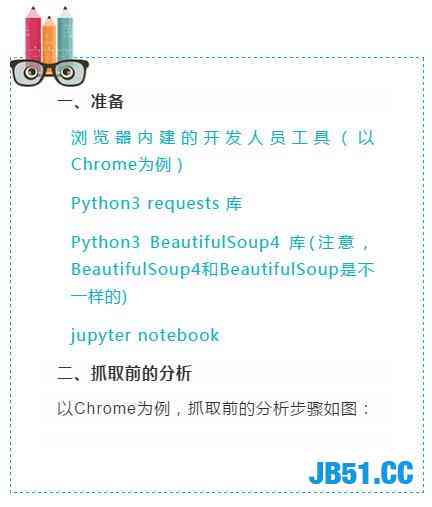

在开始编写爬虫脚本之前,首先需要并安装一款辅助编写爬虫脚本工具。这里以Python编程语言为例,介绍怎样去采用PyCrawler这款工具。

1. 保证您的计算机已安装Python环境。

2. 打开命令行窗口输入以下命令安装PyCrawler:

```

pip install PyCrawler

```

3. 安装完成后,您能够采用以下命令启动PyCrawler:

```

pycrawler

```

### 采用辅助编写爬虫脚本软件

咱们将采用PyCrawler这款辅助编写爬虫脚本工具一个简单的软件。

1. 在PyCrawler的命令行界面中,输入以下命令创建一个新的爬虫项目:

```

create-project my_spider

```

2. 进入项目目录,输入以下命令启动爬虫:

```

cd my_spider

run

```

3. PyCrawler会自动分析目标网站的结构,并生成相应的爬虫脚本。您能够依据本身的需求,对生成的脚本实修改和优化。

### 辅助编写爬虫脚本实践

下面咱们将通过一个实例,展示怎么样利用辅助编写爬虫脚本实实践。

1. 咱们需要确定要抓取的目标网站。这里以一个简单的新闻网站为例。

2. 采用PyCrawler的命令行界面,创建一个新的爬虫项目:

```

create-project news_spider

```

3. 进入项目目录输入以下命令启动爬虫:

```

cd news_spider

run

```

4. PyCrawler会自动分析目标网站的结构,并生成相应的爬虫脚本。您可依据本人的需求,对生成的脚本实行修改和优化。

以下是生成的爬虫脚本示例:

```python

# 导入PyCrawler模块

from pycrawler import Spider

# 创建爬虫类

class NewsSpider(Spider):

def start_requests(self):

# 设置起始URL

urls = ['http://www.example.com/news']

for url in urls:

yield self.request(url)

def parse(self, response):

# 解析网页内容

news_list = response.xpath('//div[@class=news-list]//li')

for news in news_list:

title = news.xpath('.//a/text()').get()

link = news.xpath('.//a/@href').get()

# 输出新闻标题和链接

print(title, link)

# 运行爬虫

if __name__ == '__mn__':

NewsSpider().run()

```

5. 运行爬虫脚本,即可自动抓取目标网站的新闻标题和链接。

通过以上实例,我们可看到辅助编写爬虫脚本的优势:自动化分析网站结构、生成爬虫脚本,大大减低了编写爬虫的难度。

## 总结

本文介绍了怎样去利用辅助编写全方位爬虫脚本从入门到高级实践。通过采用PyCrawler这款工具,您可轻松地创建和维护全方位的爬虫脚本,实现高效的网络数据抓取。期待本文对您有所帮助,您在数据抓取的道路上越走越远!

AI辅助编写全方位爬虫脚本教程:从入门到高级实践指南

编辑:ai知识-合作伙伴

本文链接:http://www.tsxnews.com.cn/2024falv/aizhishi/232543.html

上一篇:AI系统兼容性检测综述:详解全屋智能与行业应用的融合成效

下一篇:松鼠ai可视化报告能看到什么东西:详细功能与内容一览

① 凡本网注明"来源:"的所有作品,版权均属于,未经本网授权不得转载、摘编或利用其它方式使用上述作品。已经本网授权使用作品的,应在授权范围内使用,并注明"来源:XX"。违反上述声明者,本网将追究其相关法律责任。

② 凡本网注明"来源:xxx(非)"的作品,均转载自其它媒体,转载目的在于传递更多信息,并不代表本网赞同其观点和对其真实性负责。

③ 如因作品内容、版权和其它问题需要同本网联系的,请在30日内进行。

编辑推荐

- 1如何用ai写爬虫脚本教程

- 1如何用AI写爬虫脚本教程:从入门到完整教程指南

- 1对AI绘画小程序期待的文案怎么写:探讨用户需求与功能优化策略

- 1AI应用中字体颜色更改技巧:涵不同平台与工具的详细教程

- 1如何利用AI轻松调整和修改文字内容,实现字体颜色更改与个性化设置

- 1ai字体如何改颜色:包括填充颜色、设置透明色及使用快捷键修改方法

- 1AI写作工具中如何更改字体颜色、字体类型及大小:全面指南与技巧解析

- 1如何修改AI写作内容,更改文字字体颜色而不影响原有文案样式?

- 1字体修改技巧:ai类写作怎么改字体颜色、字体样式及保持颜色不变的方法

- 1科大讯飞智能办公本:轻松安装,提升办公效率

- 1科大讯飞智能办公本:高效记录与智能办公一体化解决方案

- 1讯飞智能办公本什么时候上市:使用技巧与xfcyj10e型号安装指南

- 1掌握AI绘画技巧:动物主题创意文案撰写指南

- 1如何查找剪映AI文案修改后的版本及解决相关问题:一站式指南与技巧分享

- 1剪映ai文案修改后在哪里找出来:完整教程与操作指南

- 1'如何在剪映AI中查找修改后的文案位置:快速定位指南'

- 1全方位掌握剪辑技巧:剪映专业功能与实用教程一览

- 1剪映如何编辑文案:字幕内容、字体及样式调整

- 1'剪映文本编辑功能优化与技巧提升指南'

- 1从零开始:AI小程序开发详解与常见问题解决指南

- 1AI程序怎么做:深入解析编写原理与实现步骤

- 1'智能AI脚本文案创作模型'