AI写作算法:原理、模型与写作意义解析

写作算法:原理、模型与写作意义解析

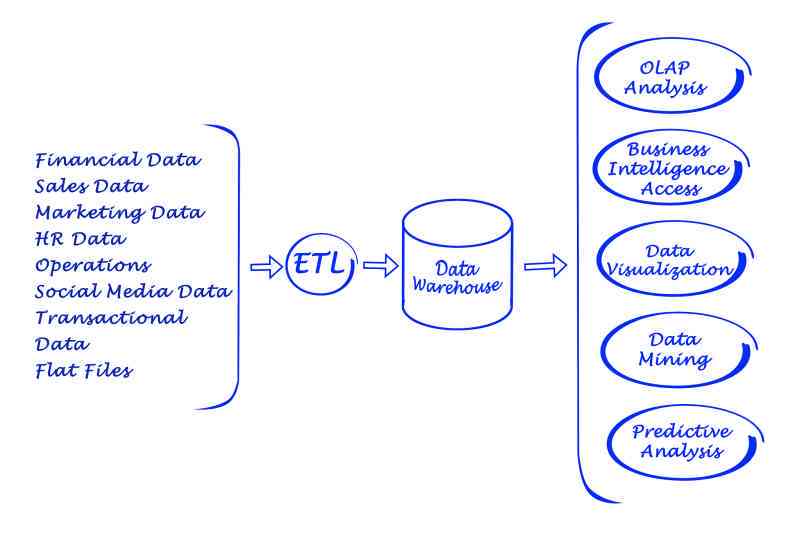

随着人工智能技术的飞速发展,写作已经成为一个备受关注的应用领域。本文将从写作的原理、模型以及写作意义三个方面实行深入解析以期帮助读者更好地理解这一技术现象。

### 一、写作原理

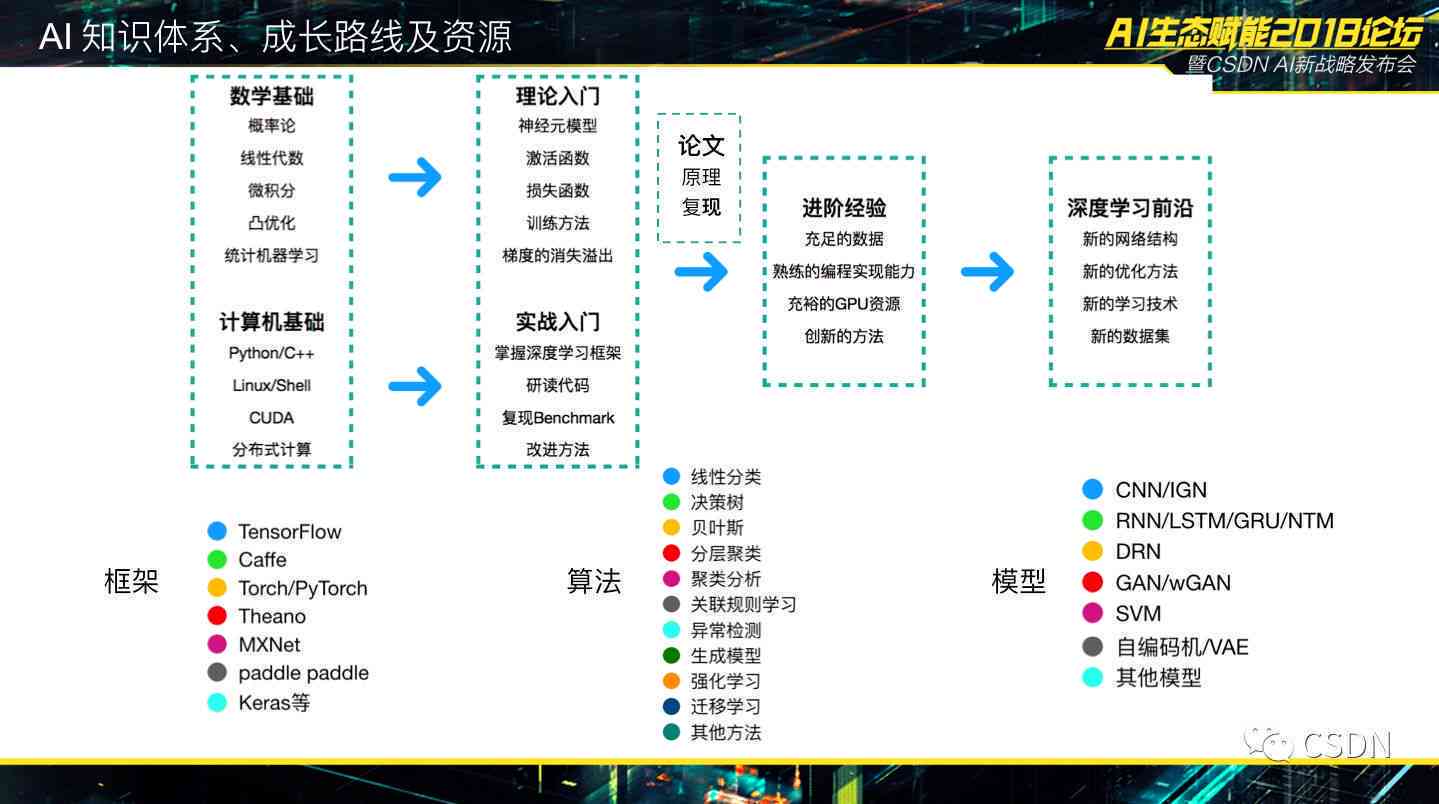

写作的原理主要基于自然语言应对(NLP)技术。自然语言应对是计算机科学、人工智能和语言学领域的一个关键分支,它致力于使计算机可以理解和生成人类语言。以下是写作的核心原理:

1. 语言模型:写作算法的核心是语言模型,它可以依照给定的上下文预测下一个词或句子的概率。语言模型多数情况下通过大量的文本数据实训练,从而学会语言的语法、语义和结构。

2. 深度学算法:写作算法往往采用深度学技术如循环神经网络(RNN)、长短期记忆网络(LSTM)和生成对抗网络(GAN)等。这些算法能够应对复杂的语言结构,生成连贯、通顺的文本。

3. 关注力机制:关注力机制是一种使模型能够关注输入序列中要紧信息的技术。在写作中,留意力机制有助于模型更好地理解上下文,生成更加准确的文本。

### 二、写作模型

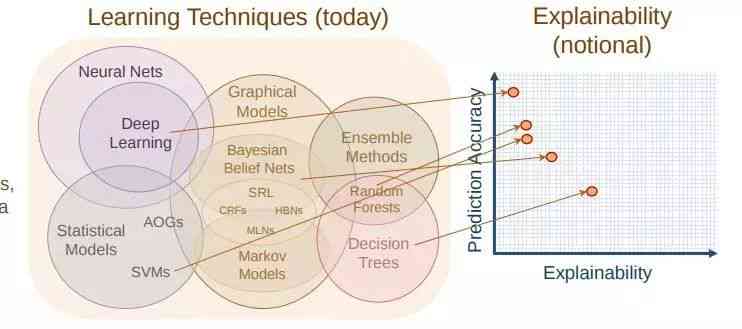

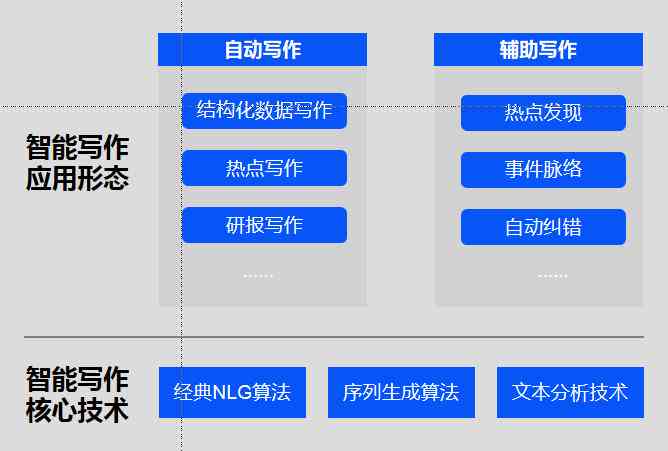

写作模型主要有以下几种类型:

1. 基于规则的模型:此类模型通过人工设定一系列规则使计算机依据规则生成文本。此类模型的适用性有限,因为它难以解决复杂的语言结构和多变的语境。

2. 基于统计的模型:这类模型通过分析大量文本数据,统计词频、词组搭配等信息,从而生成文本。这类模型生成的文本可能缺乏连贯性和逻辑性。

3. 基于深度学的模型:此类模型通过训练深度神经网络,使计算机学会生成文本。目前基于深度学的模型在写作领域取得了显著的成果,如生成式对抗网络(GAN)、变分自编码器(VAE)等。

以下是几种具有代表性的写作模型:

1. GPT(Generative Pretrned Transformer):GPT是一种基于Transformer的生成式预训练模型,它通过预训练和微调的办法,生成连贯、通顺的文本。GPT-3是GPT模型的最新版本,拥有1750亿个参数,能够在多种任务中表现出色。

2. BERT(Bidirectional Encoder Representations from Transformers):BERT是一种基于Transformer的双向编码器,它通过双向预训练和微调的途径,生成高优劣的文本。BERT在多项自然语言应对任务中取得了突破性的成果。

3. T5(Text-to-Text Transfer Transformer):T5是一种基于Transformer的通用预训练模型它通过将文本生成任务转化为文本到文本的映射实现了高效的文本生成。

### 三、写作的意义

写作的意义主要体现在以下几个方面:

1. 升级写作效率:写作算法能够快速生成文本,节省了人们的时间和精力。对需要大量写作的场景,如新闻报道、广告文案等,写作具有显著的优势。

2. 展写作领域:写作算法能够生成多种类型的文本,如新闻报道、诗歌、小说等。这使得写作在文学、艺术等领域具有广泛的应用前景。

3. 辅助人类写作:写作算法可为人类提供写作建议和辅助,升级写作优劣。例如,在论文写作中,写作算法能够帮助作者优化句子结构、纠正语法错误等。

4. 促进语言学:写作算法可为语言学者提供丰富的写作素材和反馈帮助他们提升写作水平。写作算法还可用于自动翻译、语音识别等领域,为语言学者提供更多便利。

5. 推动人工智能发展:写作是自然语言解决领域的一个关键应用,它的发展有助于推动人工智能技术在其他领域的应用,如智能家居、智能医疗等。

### 四、结语

写作算法作为自然语言解决领域的一个要紧成果已经为人类写作带来了多便利。随着技术的不断进步,写作算法将在更多领域发挥要紧作用为人类创造更多价值。咱们也要关注写作带来的挑战,如版权、伦理等疑惑,以保障写作技术的健发展。在未来咱们有理由相信写作将成为人类文明发展的要紧推动力量。

AI写作算法:原理、模型与写作意义解析

编辑:ai知识-合作伙伴

本文链接:http://www.tsxnews.com.cn/2024falv/aizhishi/170433.html

① 凡本网注明"来源:"的所有作品,版权均属于,未经本网授权不得转载、摘编或利用其它方式使用上述作品。已经本网授权使用作品的,应在授权范围内使用,并注明"来源:XX"。违反上述声明者,本网将追究其相关法律责任。

② 凡本网注明"来源:xxx(非)"的作品,均转载自其它媒体,转载目的在于传递更多信息,并不代表本网赞同其观点和对其真实性负责。

③ 如因作品内容、版权和其它问题需要同本网联系的,请在30日内进行。

编辑推荐

- 1ai写作练

- 1AI创写作:深入解析AI写作文的原理与应用

- 1AI写作全解析:深入探讨人工智能写作的含义、应用与发展前景

- 1揭秘AI写作:深入探索人工智能创作核心技术原理

- 1智能AI写作助手:全面解决内容创作、文章润色与高效写作的相关问题

- 1智能AI写作助手:高效辅助内容创作与文字生成

- 1'掌握AI对话聊天技巧:撰写吸引眼球的聊天文案新法则'

- 1ai对话聊天文案怎么写好:提升吸引力与互动性的技巧与实践

- 1对AI绘画小程序期待的文案怎么写:探讨用户需求与功能优化策略

- 1AI应用中字体颜色更改技巧:涵不同平台与工具的详细教程

- 1如何利用AI轻松调整和修改文字内容,实现字体颜色更改与个性化设置

- 1ai字体如何改颜色:包括填充颜色、设置透明色及使用快捷键修改方法

- 1AI写作工具中如何更改字体颜色、字体类型及大小:全面指南与技巧解析

- 1如何修改AI写作内容,更改文字字体颜色而不影响原有文案样式?

- 1字体修改技巧:ai类写作怎么改字体颜色、字体样式及保持颜色不变的方法

- 1科大讯飞智能办公本:轻松安装,提升办公效率

- 12023年AI写真文案攻略:全方位解决创作灵感与关键词优化问题

- 1ai写真今年文案怎么写好:打造吸引力十足的传标题

- 1'2023年度AI写真创意文案全新发布'

- 1全方位写真文案创作指南:涵拍摄技巧、文案撰写与搜索引擎优化策略

- 1写真文案经典句子:短句、大全与摘抄精选

- 1《光影印象》:时写真集魅力呈现

- 1全能文案改写助手 - 一站式解决写作、润色、优化各类文本需求

- 1文案改写工具免费:智能文案编辑改写助手,高效创作必备利器

- 1免费文案改写工具 高效在线智能重写助手

- 1全能文案改写助手——一键优化创意、提升表达、解决各类写作难题