神经网络模拟函数:如何模拟任意函数及其求解方法

在人工智能和机器学领域神经网络作为一种强大的模拟工具已被广泛应用于函数逼近、数据分类、模式识别等多个领域。神经网络模拟函数的能力使其可以逼近任意连续函数为应对复杂疑问提供了一种新的思路。本文将深入探讨神经网络怎样去模拟任意函数以及求解神经网络模拟函数的方法帮助读者更好地理解这一技术及其应用。

### 引言

函数逼近是数学和工程领域的一项关键任务它涉及到找到一个函数,使其在给定输入上尽可能接近目标函数的输出。传统方法往往依于号计算或数值分析,但面对高度复杂的非线性函数时,这些方法往往力不从心。随着神经网络技术的发展,神经网络模拟函数已成为一种具有广泛应用前景的方法。本文将详细介绍神经网络模拟函数的原理、方法及其求解过程。

### 神经网络模拟函数公式

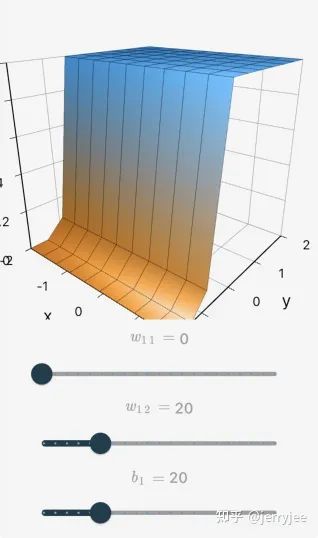

神经网络模拟函数的核心在于其数学模型。一个典型的神经网络由输入层、隐藏层和输出层组成。每个神经元都通过一系列权重与其它神经元相连,权重的大小决定了信息传递的强度。神经网络模拟函数的公式可表示为:

\\[ f(x) = \\sum_{i=1}^{n} w_i \\cdot \\sigma(\\sum_{j=1}^{m} w_{ij} \\cdot x_j b_i) \\]

其中\\( w_i \\) 和 \\( w_{ij} \\) 分别是连接权重\\( \\sigma \\) 是激活函数,\\( b_i \\) 是偏置项,\\( x_j \\) 是输入变量。

### 神经网络模拟函数是什么

神经网络模拟函数是指利用神经网络的结构和参数来逼近目标函数的过程。此类逼近不仅适用于线性函数,还能有效应对非线性函数。神经网络通过学输入与输出之间的关系,自动调整权重和偏置使得网络输出与目标函数输出尽可能接近。此类能力使得神经网络在函数逼近、数据拟合等领域具有广泛的应用。

### 神经网络模拟函数怎么求

求解神经网络模拟函数多数情况下涉及以下步骤:

1. 数据预应对:对输入数据实行归一化或标准化解决,以增强训练效率。

2. 网络结构设计:依照疑问的复杂度和数据的特点,设计合适的网络结构,涵输入层、隐藏层和输出层的神经元数量和类型。

3. 权重初始化:随机初始化权重和偏置,为训练过程提供一个初始状态。

4. 损失函数选择:选择合适的损失函数来量网络输出与目标函数输出之间的误差,如均方误差(MSE)。

5. 优化算法选择:选择合适的优化算法,如梯度下降法,来更新权重和偏置。

6. 训练与验证:通过迭代训练神经网络,并在验证集上评估模型的性能,直到满足预设的收敛条件。

### 神经网络模拟

神经网络模拟的核心在于通过训练过程自动调整网络的权重和偏置,使其可以逼近目标函数。这一过程涉及到以下关键环节:

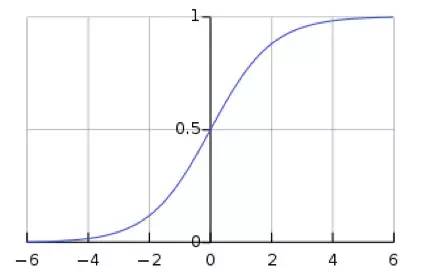

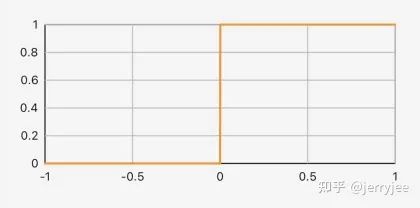

- 激活函数选择:激活函数决定了神经元的输出,常用的激活函数涵Sigmoid、ReLU和Tanh等。

- 反向传播算法:反向传播算法是神经网络训练的核心,它通过计算损失函数对权重和偏置的梯度,来更新网络的参数。

- 正则化技术:为了防止过拟合,能够采用正则化技术,如L1或L2正则化来限制网络权重的增长。

### 神经网络模拟任意函数

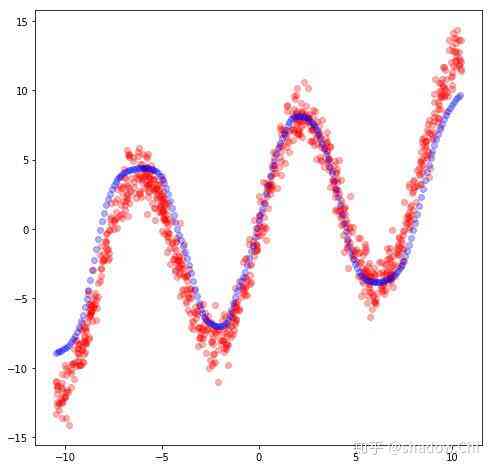

神经网络具有强大的函数逼近能力,理论上可模拟任意连续函数。这是因为神经网络的结构和参数可灵活调整,使其能够适应各种复杂函数的形状和特征。在实际应用中,神经网络已成功模拟了多种类型的函数,如多项式、指数函数、三角函数等。以下是几个关键点:

- 非线性逼近:神经网络通过引入非线性激活函数,能够逼近非线性函数。

- 泛化能力:神经网络通过在大量数据上训练能够学到函数的泛化规律,从而在新数据上也能获得良好的预测性能。

- 灵活性:神经网络的层数和神经元数量可按照需要调整,使其能够适应不同复杂度的函数。

神经网络模拟函数是一种强大的技术,它不仅能够逼近任意连续函数,还能为解决复杂疑惑提供新的思路。通过深入理解神经网络模拟函数的原理和方法,咱们能够更好地利用这一技术,为科学研究和工程应用带来更多可能性。

神经网络模拟函数:如何模拟任意函数及其求解方法

编辑:ai知识-合作伙伴

本文链接:http://www.tsxnews.com.cn/2024falv/aizhishi/107692.html

上一篇:全面解析:模拟神经网络算法在多领域应用与优化策略探究

下一篇:讯飞智能工具:一键免费在线生成新闻稿,自动创作文章内容,新闻写作新篇章

① 凡本网注明"来源:"的所有作品,版权均属于,未经本网授权不得转载、摘编或利用其它方式使用上述作品。已经本网授权使用作品的,应在授权范围内使用,并注明"来源:XX"。违反上述声明者,本网将追究其相关法律责任。

② 凡本网注明"来源:xxx(非)"的作品,均转载自其它媒体,转载目的在于传递更多信息,并不代表本网赞同其观点和对其真实性负责。

③ 如因作品内容、版权和其它问题需要同本网联系的,请在30日内进行。

编辑推荐

- 1模拟神经网络AI写作

- 1全面解析:模拟神经网络算法在多领域应用与优化策略探究

- 1神经网络驱动下的模拟预测模型:探索复杂系统行为

- 1模拟神经网络AI写作:安装与手机版,神经网络模拟算法

- 1全方位模拟神经网络:打造智能AI写作平台,解锁深度内容创作新境界

- 1'哪些智能模拟神经网络写作工具值得推荐:高效软件助力创作'

- 1智能AI文案生成器:一键解决多样化写作需求,轻松覆各类文案创作问题

- 1推荐哪些英语写作软件:哪些AI生成英文作文工具更出色?

- 1ai写作英文作文的软件叫什么:常见软件一览与推荐

- 1全面盘点:主流AI英文写作软件推荐及功能比较

- 1如何使用剪映视频剪辑软件添加人工语音配音声音教程

- 1剪映怎么找到ai创作模板:快速开启智能创作之旅

- 1剪映AI创作功能详解:全面指南教你如何轻松找到并使用AI创作工具

- 1中国人工智能市场研究报告——智能产业咨询深度解析

- 1国内免费AI写作神器哪个好用:全面比较写作软件选择

- 1AI一键生成双人民族风婚纱照及浪漫文案,全方位满足个性化婚礼筹备需求

- 1全方位辅助学:智能写作业机器人助力学生高效完成各科目作业

- 1ai智能作业安装与打印机,官网及密码找回攻略

- 1全自动智能学机:机器人手写作业新闻,探索写字机器批发价格与学效率

- 1智能写作业助手:全面支持各科目作业高效完成与学辅导

- 1ai写作英语翻译怎么写出来:完整攻略与技巧解析

- 1AI写作全解析:深度了解人工智能写作的原理、应用与未来发展

- 1AI在线写作:一键生成文章,智能英语作文,讯飞辅助,全面提升写作能力

- 1如何在安手机上免费最新版智能写作助手官方安装包

- 1AI写作助手使用指南:如何启动、操作及解决常见打开问题全解析

- 1ai智能写作软件:免费版推荐、优劣对比、指南及功能详解