深度解析:AI算法开发与应用全攻略,涵设计、实现与优化核心技术

深度解析:AI算法开发与应用全攻略,涵设计、实现与优化核心技术

# 深度解析:算法开发与应用全攻略涵设计、实现与优化核心技术

## 引言

人工智能()作为现代科技的前沿领域已经深入到了咱们生活的方方面面。Python作为一种强大的编程语言与TensorFlow等深度学框架的结合为算法的开发和应用提供了坚实基础。本文将从设计、实现与优化三个层面深度解析算法的开发与应用全攻略涵核心技术的关键要素。

## 一、设计核心算法

### 1. 算法校正

在算法设计中算法校正是一项关键技术旨在确信算法的公平性和准确性。算法校正一般涵以下几个步骤:

- 数据预解决:通过清洗和标准化数据消除数据中的噪声和偏差。

- 模型选择:选择合适的算法模型如决策树、神经网络等。

- 算法优化:通过交叉验证、超参数调整等方法,优化算法性能。

### 2. 数据集清洗

数据集的品质直接作用到算法的性能。数据集清洗涵:

- 去除异常值:识别并去除数据集中的异常值,避免其对模型训练的作用。

- 数据标注:对数据集中的样本实准确标注,保障训练数据的可靠性。

- 数据增强:通过数据增强技术,如旋转、翻转等,扩充数据集,增进模型的泛化能力。

### 3. 透明度增强

算法的透明度是指算法决策过程的可解释性。增强透明度的方法包含:

- 可视化技术:利用可视化工具,如TensorBoard,展示算法的决策过程。

- 解释模型:采用LIME(Local Interpretable Model-agnostic Explanations)等解释模型,为客户提供算法决策的解释。

## 二、实现算法

### 1. Python与TensorFlow的应用

Python作为一种易学易用的编程语言,与TensorFlow深度学框架的结合,为算法的实现提供了强大支持。以下是实现算法的关键步骤:

- 环境搭建:安装Python和TensorFlow环境,为算法开发提供基础。

- 数据加载:利用TensorFlow的数据加载功能,高效地应对大规模数据集。

- 模型构建:利用TensorFlow的API,构建神经网络模型,如卷积神经网络(CNN)或循环神经网络(RNN)。

### 2. 代码生成算法

代码生成算法通过机器学和深度学技术,自动生成代码,增进了开发效率。其关键步骤包含:

- 代码解析:分析已有代码,提取代码结构和模式。

- 代码生成:按照提取的模式,生成新的代码片。

- 代码优化:通过迭代优化,增进生成代码的优劣和效率。

### 3. 大数据和计算资源

算法的学理论基础涉及到大规模数据和强大的计算资源。以下是大数据和计算资源在算法实现中的作用:

- 数据驱动:利用大量数据,加强模型的泛化能力和准确性。

- 计算加速:采用GPU等硬件加速设备,加快模型训练速度。

## 三、优化算法

### 1. 变分自编码器(VAEs)

变分自编码器是一种基于概率模型的生成方法,通过学数据的潜在表示,实现了高优劣的数据生成。以下是VAEs在算法优化中的应用:

- 数据生成:VAEs可以生成新的数据样本用于扩充数据集。

- 特征提取:VAEs可以学数据的潜在特征,用于特征降维。

### 2. 人工智能的常用十种算法

以下是人工智能领域常用的十种算法,这些算法在算法优化中发挥了要紧作用:

1. 决策树:依据特征实分类,通过节点难题逐步分割数据。

2. 支持向量机(SVM):寻找更优分割超平面,实现数据分类。

3. 神经网络:模拟人脑神经元结构,实现复杂函数逼近。

4. 聚类算法:依照数据特征,将数据分为多个类别。

5. 叶斯算法:基于概率模型,实行数据分类和预测。

6. 集成学:结合多个模型,增进预测准确率。

7. 深度学:通过多层神经网络,实现复杂任务的学和预测。

8. 强化学:通过与环境的互动,学策略。

9. 遗传算法:模拟生物进化过程,优化算法性能。

10. 模糊逻辑:应对不确定性和模糊性,实现智能决策。

### 3. 优化技术

优化算法的关键技术包含:

- 超参数调整:通过调整学率、批次大小等超参数,优化模型性能。

- 模型融合:结合多个模型,升级预测准确率和稳定性。

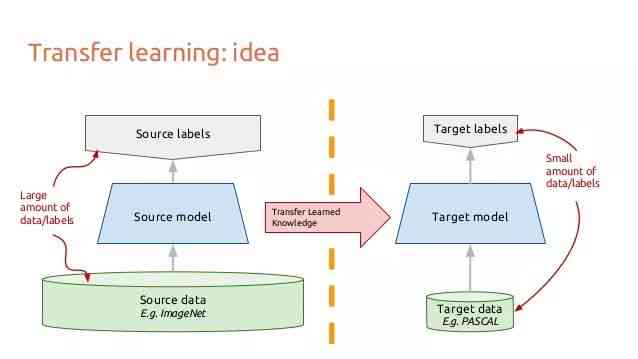

- 迁移学:利用预训练模型,快速适应新任务。

## 结论

算法的开发与应用是一个涉及设计、实现和优化的复杂过程。通过深入理解核心算法原理,掌握Python和TensorFlow等工具的采用以及运用

深度解析:AI算法开发与应用全攻略,涵设计、实现与优化核心技术

编辑:ai学习-合作伙伴

本文链接:http://www.tsxnews.com.cn/2024falv/aixuexi/59090.html

① 凡本网注明"来源:"的所有作品,版权均属于,未经本网授权不得转载、摘编或利用其它方式使用上述作品。已经本网授权使用作品的,应在授权范围内使用,并注明"来源:XX"。违反上述声明者,本网将追究其相关法律责任。

② 凡本网注明"来源:xxx(非)"的作品,均转载自其它媒体,转载目的在于传递更多信息,并不代表本网赞同其观点和对其真实性负责。

③ 如因作品内容、版权和其它问题需要同本网联系的,请在30日内进行。

编辑推荐

- 1ai算法生成原理

- 1人工智能基本算法开发与实流程解析

- 1AI算法一键脱装消衣手机国内外版及工程师必备学指南

- 1深入解析AI算法生成技术原理及其广泛应用

- 1ai算法生成原理是什么:深度解析AI算法生成机制

- 1如何正确使用AI写作管家工具高效写作方法与软件操作指南

- 1全面指南:AI写作管家的正确使用方法与常见问题解答

- 1如何正确使用智能写作助手——免费软件管家工具,打造高效文章创作平台教程

- 1中文AI写作:平台推荐、检测与转英文查重全解析

- 1智能AI文字创意设计工具:一键生成多样化视觉内容,满足各类设计需求

- 1浪漫小屋:AI绘画打造梦幻房子空间

- 1ai自动生成绘画软件:在线制作与排行榜,含电脑版热门推荐

- 1AI生成绘画作品:探索智能艺术创作与无限创意可能性

- 1升腾科技-升腾科技怎么样

- 1ai写作与文学创作的区别:探究二者差异及相互联系

- 1写作助手猫:尊享会员专属体验

- 1全面指南:秘塔写作猫使用教程与常见问题解答

- 1秘塔写作猫账号共享后被注销,账号密码问题及解决方法一览

- 1智能工业设计软件:自动生成工业产品设计的创新工具

- 1AI技术在工业生产中的应用:自动生成多样化工业产品及解决方案

- 1ai自动生成logo:免费一键生成,智能设计无需付费

- 1热门AI写作软件盘点:全面解析网上大火的智能写作工具及其功能特点

- 1网上热门推荐:哪些免费好用的智能写作软件生成工具值得尝试

- 1网上很火的AI写作软件是什么:盘点热门AI智能写作软件及优劣对比

- 12023年度AI智能写作软件评测:全方位对比与推荐指南