ai写作鉴别

在数字化浪潮的推动下人工智能技术已逐渐渗透到各个领域写作也不例外。随着写作技术的不断进步人们对其鉴别能力产生了浓厚的兴趣。写作鉴别,即在众多文本中判断哪些是由人工智能生成的,哪些是人类的原创作品。这项技术的出现不仅引发了关于创作归属权的讨论,更是对传统写作模式的一种挑战。本文将深入探讨写作的原理、算法、意义以及模型,以揭示其背后的技术奥秘。

一、写作的含义与挑战

写作,指的是利用人工智能技术,通过特定的算法和模型,自动生成文本的过程。这类技术可在短时间内产生大量内容,从新闻报道到文学作品,无所不包。写作也带来了多挑战,如怎样去保证文本的优劣和准确性,怎么样避免抄袭和侵权,以及怎样去鉴别写作与人类写作的区别。

本文将分别从写作原理、算法、意义和模型等方面,详细探讨这一技术。

二、写作原理

写作的原理基于自然语言应对(NLP)技术,这是一种使计算机可以理解和生成人类语言的技术。其核心是利用大量的文本数据,通过机器学算法训练出能够识别和生成文本的模型。

写作原理主要涵以下几个步骤:

1. 数据收集:收集大量的文本数据,涵文学作品、新闻报道、学术论文等,作为训练数据。

2. 数据预应对:对收集到的文本实行清洗、分词、去停用词等操作以便于后续的模型训练。

3. 模型训练:利用机器学算法,如深度学中的循环神经网络(RNN)或变换器(Transformer),对应对后的数据实训练,学文本的生成规律。

4. 文本生成:训练好的模型依照输入的提示或上下文,自动生成文本。

三、写作算法

写作算法是写作技术的核心,它决定了文本生成的优劣和效率。以下是若干常见的写作算法:

1. 生成对抗网络(GAN):GAN由两部分组成生成器和判别器。生成器负责生成文本,而判别器则负责判断生成的文本是不是真实。通过不断迭代训练,生成器能够生成越来越真实的文本。

2. 循环神经网络(RNN):RNN是一种能够应对序列数据的神经网络。在写作中,RNN能够用来预测下一个词语或句子,生成连贯的文本。

3. 变换器(Transformer):Transformer是一种基于关注力机制的深度学模型,它能够捕捉文本中的长距离依关系生成更加流畅和自然的文本。

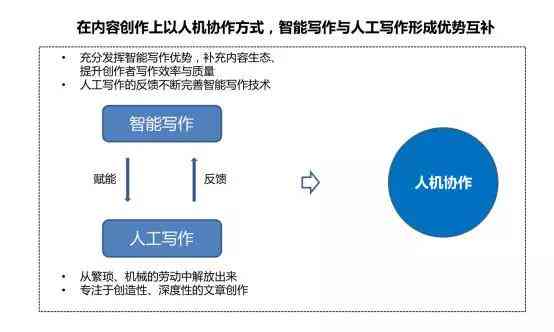

四、写作的意义

写作的意义在于它能够增进写作效率,减少创作成本,并为人类创作提供新的思路和灵感。以下是写作的若干具体意义:

1. 加强效率:写作可在短时间内生成大量内容节省了人力和时间成本。

2. 丰富创作形式:写作可尝试不同的写作风格和体裁为人类创作提供新的思路和灵感。

3. 促进学术研究:写作可用于学术领域,帮助研究者快速生成论文摘要、报告等文本升级研究效率。

4. 辅助教育:写作能够用于辅助教育,帮助学生练写作,提供个性化的写作建议和反馈。

五、写作模型

写作模型是写作技术的具体实现,以下是部分常见的写作模型:

1. GPT模型:GPT(Generative Pretrned Transformer)是一种基于Transformer的预训练模型,它通过预训练和微调的方法,生成高品质的自然语言文本。

2. BERT模型:BERT(Bidirectional Encoder Representations from Transformers)是一种双向Transformer模型它通过双向预训练和微调生成更加准确和自然的文本。

3. GLM模型:GLM(General Language Modeling)是一种结合了Transformer和RNN优点的模型,它能够生成更加流畅和多样化的文本。

写作鉴别技术是人工智能在写作领域的一种关键应用。通过深入理解写作的原理、算法、意义和模型,咱们可更好地理解这项技术的优势和挑战,为未来的写作创作和研究提供新的思路和方向。

ai写作鉴别

编辑:ai学习-合作伙伴

本文链接:http://www.tsxnews.com.cn/2024falv/aixuexi/488813.html

上一篇:ai影视动漫创作公司排名

下一篇:ai智能编导文案怎么写

① 凡本网注明"来源:"的所有作品,版权均属于,未经本网授权不得转载、摘编或利用其它方式使用上述作品。已经本网授权使用作品的,应在授权范围内使用,并注明"来源:XX"。违反上述声明者,本网将追究其相关法律责任。

② 凡本网注明"来源:xxx(非)"的作品,均转载自其它媒体,转载目的在于传递更多信息,并不代表本网赞同其观点和对其真实性负责。

③ 如因作品内容、版权和其它问题需要同本网联系的,请在30日内进行。