ai写作希特:含义、原理、算法及模型解析

写作希特:含义、原理、算法及模型解析

在当今时代人工智能()已经渗透到咱们生活的方方面面而写作作为其中的一个关键分支,正逐渐改变着人们的写作方法。本文将从写作的含义、原理、算法及模型等方面实行深入解析以帮助读者更好地理解这一技术。

### 一、写作的含义

写作,顾名思义,是指利用人工智能技术实行写作的过程。它涵了从文本生成、编辑到排版等一系列环节旨在通过智能算法增强写作效率、减少写作难度,并升级文本品质。写作不仅可以帮助人们完成日常写作任务,还能够应用于新闻报道、文学创作、商业报告等多个领域。

### 二、写作的原理

写作的原理基于深度学技术和自然语言解决(NLP)。以下是写作的基本原理:

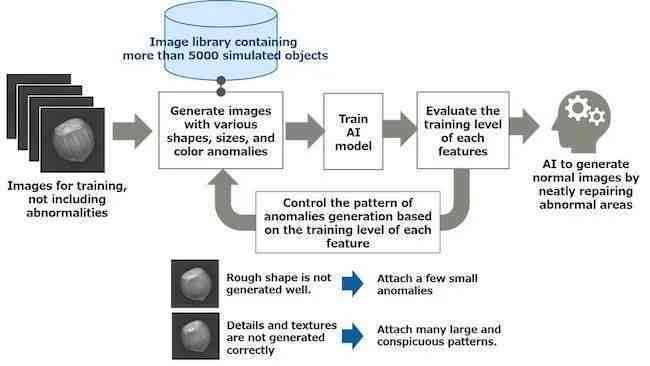

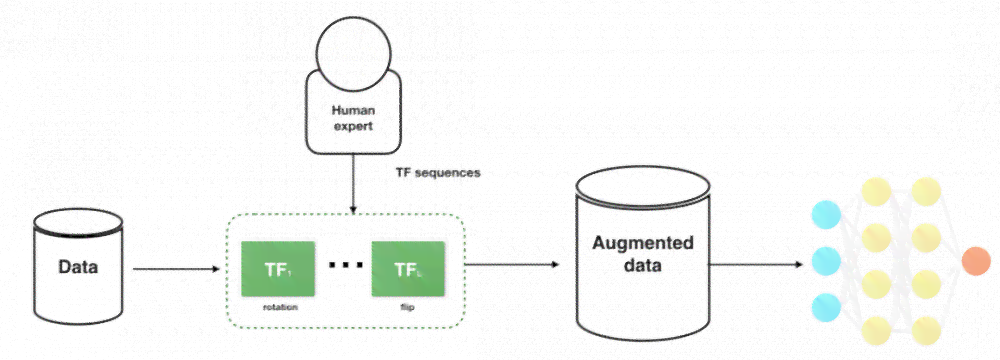

1. 数据收集与应对:写作系统首先需要收集大量的文本数据,涵书、文章、网页等。这些数据经过预解决,包含去除噪音、分词、词性标注等,以便于后续的模型训练。

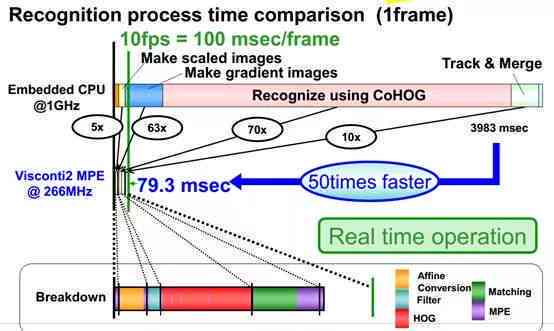

2. 模型训练:通过深度学算法写作系统可从这些数据中学到语言的规律和模式。常用的训练方法涵神经网络、循环神经网络(RNN)、长短期记忆网络(LSTM)等。

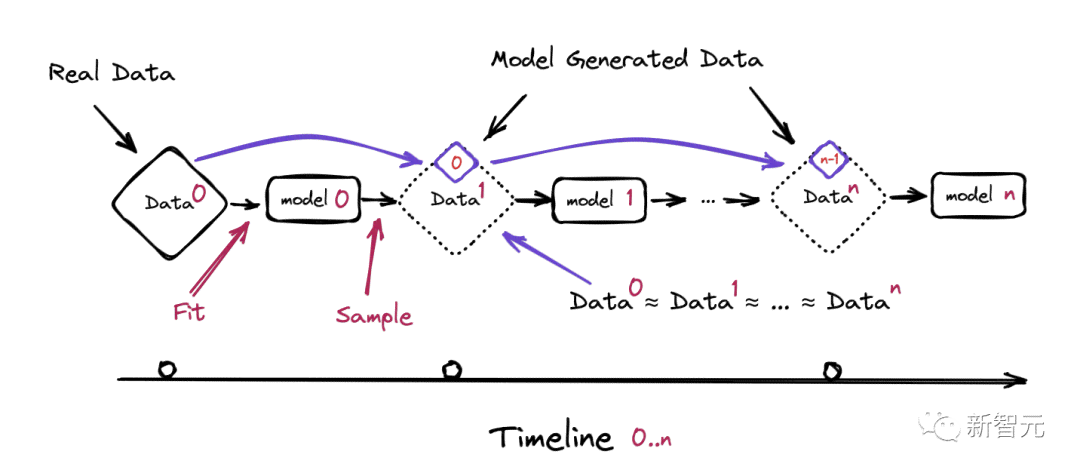

3. 文本生成:在模型训练完成后,写作系统可依照输入的上下文信息,利用训练好的模型生成新的文本。这个过程一般采用概率模型,如生成对抗网络(GAN)等。

4. 优化与反馈:生成的文本经过评估和反馈,写作系统可不断优化模型,增强文本优劣。

### 三、写作的算法

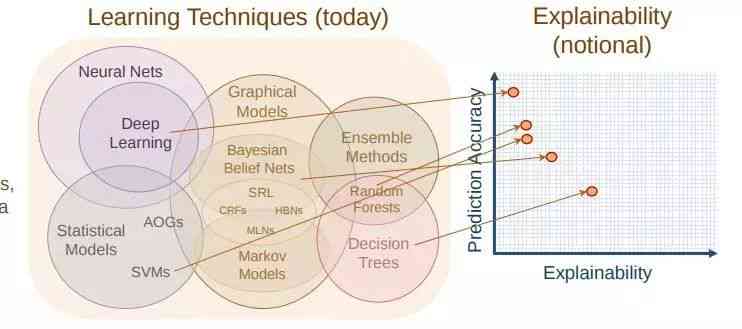

写作的实现依于多种算法,以下是部分常用的算法:

1. 循环神经网络(RNN):RNN是一种能够解决序列数据的神经网络,适用于文本生成任务。它通过记忆前一个时间点的状态,来预测下一个时间点的输出。

2. 长短期记忆网络(LSTM):LSTM是RNN的一种改进,它能够解决长序列数据中的梯度消失难题,增进文本生成的准确性。

3. 生成对抗网络(GAN):GAN由生成器和判别器组成,生成器负责生成文本,判别器负责判断生成的文本是不是真实。通过两者的对抗过程,生成的文本品质逐渐增强。

4. 留意力机制(Attention):留意力机制允模型在应对序列数据时,关注关键部分,从而加强文本生成的优劣。

### 四、写作的模型

写作模型是指应用于写作任务的具体模型,以下是部分常见的写作模型:

1. 语言模型:语言模型是基于概率的文本生成模型它可按照输入的上下文信息,预测下一个词或字的概率分布。常用的语言模型涵n-gram模型、神经网络语言模型等。

2. 序列到序列模型(Seq2Seq):Seq2Seq模型将输入序列映射到输出序列,常用于机器翻译和文本生成任务。它往往由编码器和解码器组成,其中编码器负责将输入序列编码为内部表示,解码器则依据内部表示生成输出序列。

3. 变分自编码器(VAE):VAE是一种生成模型它通过编码器将输入数据编码为潜在空间的表示,然后通过解码器将这些潜在空间的表示解码为输出数据。VAE在文本生成任务中能够生成多样化和高品质的文本。

4. 预训练语言模型:如GPT(生成式预训练模型)和BERT(双向编码器表示)等,这些模型在大规模文本数据上实预训练,能够捕捉到丰富的语言特征进而用于各种写作任务。

### 五、总结

写作作为人工智能技术的要紧应用正在为各行各业带来革命性的变化。通过对写作的含义、原理、算法及模型的深入解析,咱们不仅能够更好地理解这一技术,还能够探索其在未来发展的无限可能。随着技术的不断进步,写作有望在新闻报道、文学创作、科学研究等领域发挥更大的作用,为人类创造更多的价值。

ai写作希特:含义、原理、算法及模型解析

编辑:ai学习-合作伙伴

本文链接:http://www.tsxnews.com.cn/2024falv/aixuexi/185219.html

上一篇:数字艺术ai智能创作大赛:官网作品展示与创意作品大赛

下一篇:掌握三星Galaxy Fold5 AI智能写作助手:轻松创作各类文案的全面指南

① 凡本网注明"来源:"的所有作品,版权均属于,未经本网授权不得转载、摘编或利用其它方式使用上述作品。已经本网授权使用作品的,应在授权范围内使用,并注明"来源:XX"。违反上述声明者,本网将追究其相关法律责任。

② 凡本网注明"来源:xxx(非)"的作品,均转载自其它媒体,转载目的在于传递更多信息,并不代表本网赞同其观点和对其真实性负责。

③ 如因作品内容、版权和其它问题需要同本网联系的,请在30日内进行。

编辑推荐

- 1王热血挑战:巅峰对决精彩Battle

- 1王吃药了吗:揭秘运动员用药争议及 检测新规

- 1智能写作助手:全方位提升文章创作效率与质量的人工智能写作软件解析

- 1对AI绘画小程序期待的文案怎么写:探讨用户需求与功能优化策略

- 1AI应用中字体颜色更改技巧:涵不同平台与工具的详细教程

- 1如何利用AI轻松调整和修改文字内容,实现字体颜色更改与个性化设置

- 1ai字体如何改颜色:包括填充颜色、设置透明色及使用快捷键修改方法

- 1AI写作工具中如何更改字体颜色、字体类型及大小:全面指南与技巧解析

- 1如何修改AI写作内容,更改文字字体颜色而不影响原有文案样式?

- 1字体修改技巧:ai类写作怎么改字体颜色、字体样式及保持颜色不变的方法

- 1AI智能写作助手:全面覆文章创作、编辑与优化,一站式解决写作难题的

- 1ai智能写作手机版免费使用,不限次数,售价168元详解

- 1'智能AI创作助手——一键生成个性化小程序'

- 1一站式智能写作AI答案汇总:完整指南与实用教程

- 1智能写作ai全部答案:大全与AI智能写作指南

- 1全面攻略:AI智能写作助手全解与答案汇编宝典

- 1AI智能写作:全面覆创意生成、内容优化与高效编辑,解决多样化写作需求

- 1智能写作:免费AI助手软件推荐,哪款写作用

- 1智能创作新篇章:5118高效智能写作助手

- 1AI拍照文案攻略:轻松打造简单日常风格,全面涵拍照技巧与实用建议