ai写作什么意思:深入解析ai写作原理、算法及其利弊

在数字化时代的浪潮中,人工智能()已经渗透到了咱们生活的方方面面,其中,写作作为一种新兴的技术,正在逐步改变内容创作的面貌。它不仅可以高效地生成文章、报告,甚至还能创作诗歌和小说。本文将深入探讨写作的含义,剖析其背后的原理和算法并客观分析写作的利与弊,以帮助读者更全面地理解这项技术。

### 引言

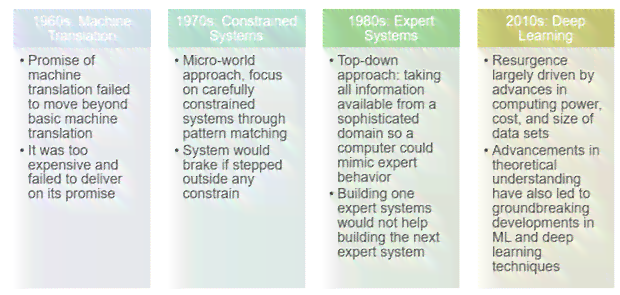

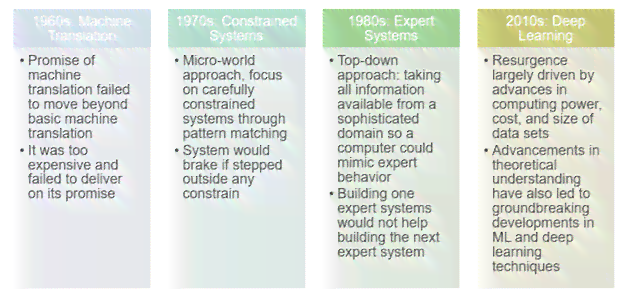

写作,简而言之就是利用人工智能技术自动生成文本的过程。此类技术基于复杂的算法和大量数据训练,可以模仿人类的写作风格和逻辑。随着深度学等技术的发展,写作已经取得了显著的进步但同时也引发了一系列关于创作、版权和伦理的讨论。本文将从写作的定义出发,逐步深入解析其原理、算法并探讨其在实际应用中的优势与不足。

### 写作什么意思

写作指的是通过人工智能技术,特别是自然语言应对(NLP)和机器学算法,自动生成文本的过程。这类技术能够应用于新闻报道、广告文案、社交媒体内容、技术文档等多个领域。写作的核心在于理解和生成人类语言,它能够按照给定的主题、风格和格式创作出合请求的文本。

### 写作的利与弊

#### 利

1. 效率提升:写作能够迅速生成大量文本,大大增强了内容生产的效率。对需要大量内容的企业和媒体对于,这一点其要紧。

2. 成本节约:与传统的人工写作相比,写作能够节省人力成本。在应对重复性或模板化的写作任务时,的优势更为明显。

3. 数据驱动:写作基于大量数据训练,能够生成更加客观、准确的内容。在数据分析报告、市场调研等领域,写作具有显著的优势。

#### 弊

1. 创意缺失:虽然写作能够生成大量内容但它往往缺乏真正的创意和灵感。在需要深度思考和创造性思维的领域,写作可能无法取代人类。

2. 伦理疑问:写作涉及版权、原创性和道德责任等疑惑。倘使生成的文本未经授权地采用了他人的作品或会引发法律纠纷。

3. 优劣不一:写作的优劣受限于算法和训练数据的品质。在某些复杂或专业领域,生成的文本可能无法达到专业水平。

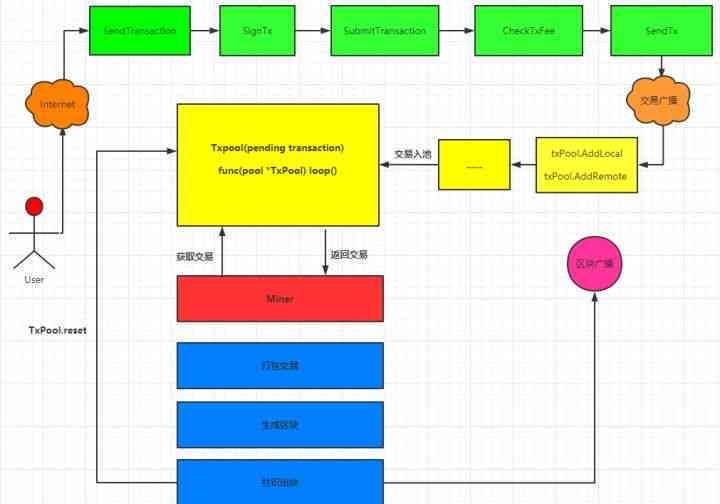

### 写作原理

写作的核心原理是基于自然语言应对(NLP)和机器学。NLP技术使计算机能够理解和生成人类语言,而机器学则通过大量数据训练模型,使其能够自动识别模式并生成文本。具体对于写作的原理包含以下几个步骤:

1. 数据收集:收集大量的文本数据,用于训练机器学模型。

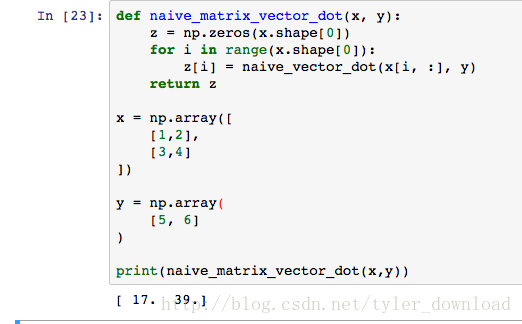

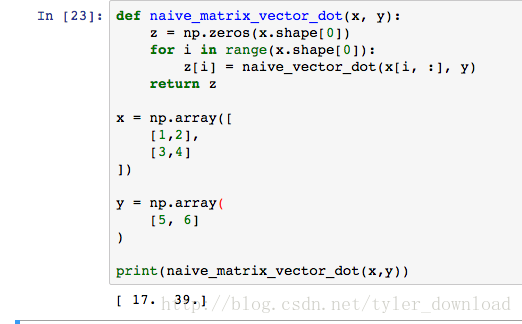

2. 模型训练:采用深度学算法,如循环神经网络(RNN)或变压器模型(Transformer),训练模型理解和生成文本。

3. 文本生成:依据给定的主题和风格模型自动生成文本。

### 写作算法

写作的算法主要涵两种:基于规则的算法和基于机器学的算法。

#### 基于规则的算法

此类算法通过预先设定的规则和模板来生成文本。它多数情况下适用于结构化和模板化的写作任务如生成产品描述、天气预报等。此类方法的优点是简单、直接,但缺点是灵活性差,难以应对复杂或非结构化的写作任务。

#### 基于机器学的算法

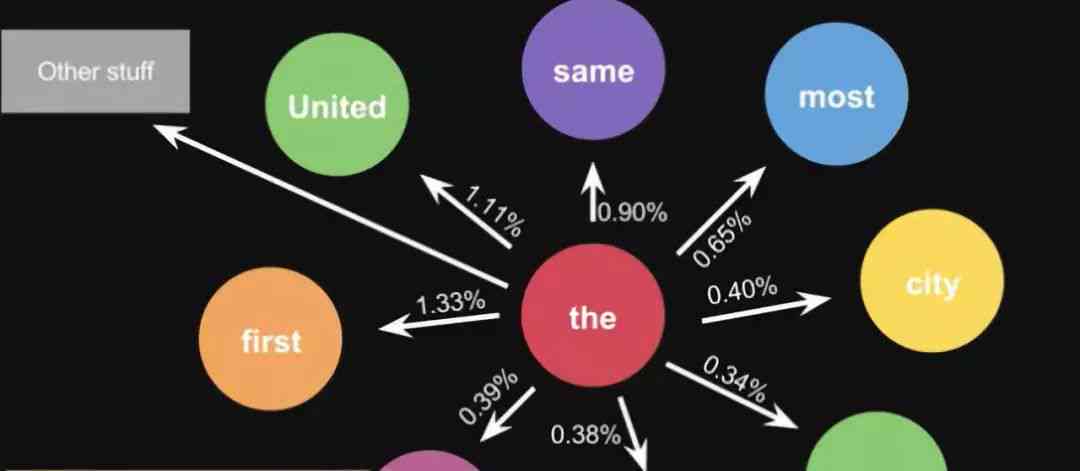

此类算法通过大量数据训练,使模型能够自动识别语言模式和生成文本。其中,循环神经网络(RNN)和变压器模型(Transformer)是最常用的两种算法。

- 循环神经网络(RNN):RNN能够应对序列数据适用于文本生成任务。它通过记忆前一个时间点的信息来生成下一个时间点的文本。

- 变压器模型(Transformer):Transformer是一种更为先进的算法,它通过自关注力机制来理解和生成文本。GPT-3和BERT等模型都是基于Transformer算法的。

### 结语

写作作为一种新兴技术,以其高效的文本生成能力和广泛的应用前景,正在逐渐改变内容创作的格局。它也面临着创意缺失、伦理疑惑等挑战。未来,随着技术的不断进步,我们期待写作能够在保持效率的同时更好地模仿人类的创造力和思考能力,为人类带来更多的价值。

ai写作什么意思:深入解析ai写作原理、算法及其利弊

编辑:ai学习-合作伙伴

本文链接:http://www.tsxnews.com.cn/2024falv/aixuexi/181063.html

上一篇:投稿涉嫌抄袭的处理方法与补救策略:如何应对抄袭指控及防范措

下一篇:ai脚本插件咋用啊:安全使用与2021脚本应用指南

① 凡本网注明"来源:"的所有作品,版权均属于,未经本网授权不得转载、摘编或利用其它方式使用上述作品。已经本网授权使用作品的,应在授权范围内使用,并注明"来源:XX"。违反上述声明者,本网将追究其相关法律责任。

② 凡本网注明"来源:xxx(非)"的作品,均转载自其它媒体,转载目的在于传递更多信息,并不代表本网赞同其观点和对其真实性负责。

③ 如因作品内容、版权和其它问题需要同本网联系的,请在30日内进行。

编辑推荐

- 1ai写作天花板

- 1AI智能创作工具:全方位辅助写作,解决各类文本创作需求

- 1深入解析:AI写作的算法原理与智能生成机制

- 1AI写作助手:全方位解决写作难题与提升文章质量的关键技巧

- 1'智能在线作文批改与辅导系统'

- 1智能作文批改网:一站式智能批改作文软件与在线服务,支持公众号使用

- 1深入解析:AI智能批改作文技术的原理与应用,全面解答写作提升疑问

- 1对AI绘画小程序期待的文案怎么写:探讨用户需求与功能优化策略

- 1AI应用中字体颜色更改技巧:涵不同平台与工具的详细教程

- 1如何利用AI轻松调整和修改文字内容,实现字体颜色更改与个性化设置

- 1ai字体如何改颜色:包括填充颜色、设置透明色及使用快捷键修改方法

- 1AI写作工具中如何更改字体颜色、字体类型及大小:全面指南与技巧解析

- 1如何修改AI写作内容,更改文字字体颜色而不影响原有文案样式?

- 1字体修改技巧:ai类写作怎么改字体颜色、字体样式及保持颜色不变的方法

- 1AI写作助手效果评测:功能、优势与用户真实体验分析

- 1ai画鼠标:如何用鼠标控制大小、设置移动距离、手绘及实现放大缩小功能

- 1'智能文案助手:AI赋能,轻松撰写各类文章软件'

- 1AI文案创作全攻略:轻松掌握任意主题写作技巧,全面解答用户文案需求

- 1AI智能写文案——内测版神器,智能文案创作软件

- 1智能AI辅助下的高效文案创作工具

- 1智能AI文案助手:一键生成多样化内容,全面解决文章创作与营销推广需求

- 1ai智能文案自动生成:免费在线软件及网页一览

- 1AI创作歌曲版权归属探讨:创作者与人工智能的权益分配

- 1掌握AI创作资源搜索技巧:全方位指南,助您快速找到优质AI创作工具与平台